文章編號:11494時間:2024-10-01人氣:

Hadoop 分布式文件系統 (HDFS) 是 Hadoop 生態系統中的一個核心組件。它是一個分布式文件存儲系統,用于在 Hadoop 集群中存儲和管理海量數據。

HDFS 旨在高度容錯、可擴展和可靠,使其成為處理大型數據集的理想解決方案。

HDFS 由兩個主要組件組成:NameNode 和 DataNode。

NameNode 是 HDFS 的全局命名空間管理器。它負責管理 HDFS 中的所有文件和目錄,并跟蹤文件在 DataNode 上的位置。

DataNode 是 HDFS 數據存儲的分布式服務器。它們存儲實際的數據塊,并負責處理客戶端請求。

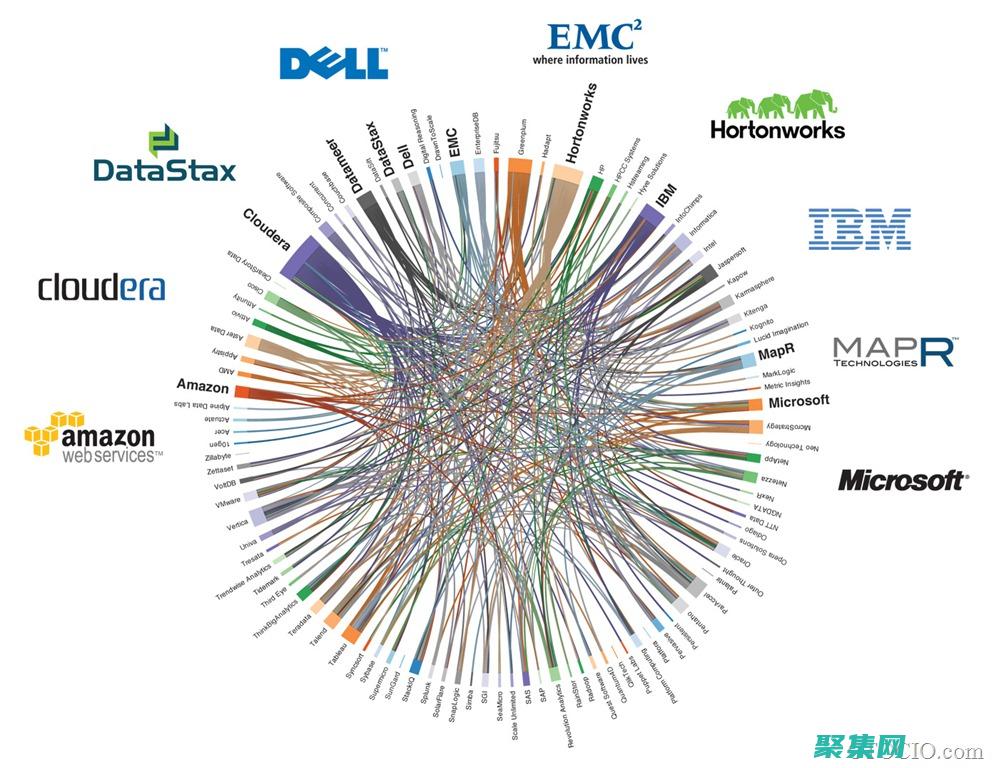

HDFS 與其他 Hadoop 組件緊密集成,創建了一個功能強大的生態系統,用于處理大數據。

MapReduce 是 Hadoop 生態系統中用于分布式處理大數據集的框架。HDFS 是 MapReduce 框架的基礎,它提供數據存儲和管理。

MapReduce 作業將數據塊從 HDFS 讀取到計算節點,進行處理,然后將結果寫入回 HDFS。

Yarn 是 Hadoop 生態系統中的資源管理系統。它負責管理 Hadoop 集群中的資源,包括 CPU、內存和存儲。

HDFS 與 Yarn 集成,允許 Yarn 為 MapReduce 作業和其他 Hadoop 應用程序分配資源。

HBase 是 Hadoop 生態系統中面向列的 NoSQL 數據庫。它利用 HDFS 作為其底層存儲系統,提供對數據的快速和靈活訪問。

HBase 使用 HDFS 存儲其數據表,并通過 Hadoop 生態系統中的其他組件進行管理和分析。

Hive 是 Hadoop 生態系統中用于數據倉庫的工具。它提供了一種使用類 SQL 查詢語言對 HDFS 中存儲的數據進行查詢和分析的方法。

Hive 與 HDFS 集成,使其能夠直接從 HDFS 中讀取和寫入數據。

Spark 是 Hadoop 生態系統中用于分布式計算的框架。它提供了比 MapReduce 更快的內存計算引擎,并以交互式方式支持對數據的探索和分析。

Spark 與 HDFS 集成,使其能夠讀取和寫入 HDFS 中的數據。

HDFS 在 Hadoop 生態系統中扮演著至關重要的角色。它提供了一個可靠且可擴展的數據存儲平臺,支持 Hadoop 生態系統中各種組件的分布式處理、分析和存儲。

通過與其他 Hadoop 組件的緊密集成,HDFS 使組織能夠有效地管理和處理海量數據集,從而獲得有價值的見解并做出明智的決策。

Hadoop三個組件的關系是緊密相連、協同工作的,它們共同構成了Hadoop分布式計算框架的基石,這三個組件分別是:HDFS(Hadoop Distributed File System)、MapReduce和YARN(Yet Another Resource Negotiator)。 首先,HDFS是Hadoop的文件存儲系統,它提供了一個高度可擴展的分布式文件系統,用于在低成本硬件上存儲大量數據。 HDFS的設計特點使其能夠處理PB級別的數據,并通過數據冗余機制保證數據的可靠性。 在Hadoop框架中,HDFS扮演著數據的“倉庫”角色,它負責數據的存儲和管理,為后續的數據處理和分析提供穩定的數據基礎。 其次,MapReduce是Hadoop的數據處理引擎,它負責大數據的計算和分析工作。 MapReduce編程模型簡潔而強大,允許用戶編寫兩個主要函數:Map函數和Reduce函數,用于處理和分析存儲在HDFS中的大規模數據集。 Map函數負責將輸入數據拆分成多個鍵值對,而Reduce函數則對這些鍵值對進行匯總和處理,最終輸出結果。 通過MapReduce,用戶可以輕松實現對海量數據的并行處理和分析。 最后,YARN是Hadoop的資源管理系統,它負責整個集群資源的分配和調度。 YARN的出現極大地提高了Hadoop集群的資源利用率和作業的運行效率。 YARN將資源管理和作業調度分離,使得多個應用程序可以共享同一個Hadoop集群的資源。 這種架構使得Hadoop不再僅僅局限于批處理場景,還能夠支持實時計算、交互式查詢等多種類型的數據處理任務。 綜上所述,HDFS、MapReduce和YARN三者相輔相成,共同構成了Hadoop強大的分布式計算能力。 HDFS提供了海量數據的存儲能力,MapReduce賦予了數據處理和分析的能力,而YARN則確保了整個系統的資源得到高效利用。 這三個組件的緊密結合,使得Hadoop能夠輕松應對大數據時代帶來的挑戰,成為企業和研究機構進行大數據處理的首選平臺。 例如,在電商領域,Hadoop可以幫助企業分析用戶行為數據,挖掘潛在商機;在科研領域,Hadoop可以助力科學家處理復雜的實驗數據,加速科研成果的產出。

Hadoop 生態系統組件詳解Hadoop 生態系統由多個關鍵組件構成,它們各自解決特定問題,共同構建了大數據處理的強大平臺。 首先,HDFS(Hadoop分布式文件系統)作為基礎存儲,提供了高容錯性和高吞吐量的數據存儲,適合處理大型數據集。 接著是MapReduce,它是一個計算模型,通過劃分為Map和Reduce步驟,實現分布式并行處理,適合大量數據的計算任務。 HBase 則是一個可擴展的、面向列的數據庫,支持實時數據訪問,尤其適合與MapReduce結合使用。 Hive是數據倉庫工具,提供結構化數據處理,類似SQL的查詢語言使數據分析更為便捷。 Pig則提供了一種更抽象的編程模型,用于簡化數據處理流程。 在分布式一致性方面,ZooKeeper扮演著重要角色,解決分布式系統中的決策一致性和數據管理問題。 Mahout負責機器學習算法的擴展,Flume負責日志收集,而Sqoop則負責數據在結構化和Hadoop之間的數據交換。 Accumulo是一個分布式、高性能的存儲解決方案,Spark則是一個快速的通用計算引擎,優化了迭代任務。 Avro作為數據序列化系統,解決了Hadoop RPC的性能瓶頸問題。 此外,Apache Crunch簡化了MapReduce任務編寫,Hue提供了Hadoop的用戶界面,Impala提供快速查詢,而Kafka則支持實時流處理。 Kudu和Oozie分別關注列式存儲和工作流調度,Sentry負責實時錯誤追蹤。 每個組件都在Hadoop生態系統中發揮著不可或缺的作用,共同構建了大數據處理的完整解決方案。

Hadoop的核心組件是分布式文件系統(HDFS)和分布式計算框架(MapReduce)。 首先,讓我們詳細了解一下HDFS(Hadoop Distributed File System)。 HDFS是Hadoop生態系統中的關鍵組件,主要用于存儲大規模數據集。 它的設計目的是確保數據的高可靠性和高可用性。 為了實現這一目標,HDFS將數據分散存儲在集群的多個節點上,并支持數據冗余備份。 這種分布式存儲方式不僅提高了數據的容錯性,還使得Hadoop系統能夠高效地處理大規模數據。 接下來是MapReduce,這是Hadoop中的另一個核心組件。 MapReduce是一個編程模型,用于將大規模數據處理作業拆分成小的任務,并在集群中并行執行。 通過將數據分成多個小塊,并將計算任務分配到多個節點上,MapReduce能夠顯著提高數據處理的速度和效率。 此外,MapReduce框架還具有自動管理任務調度、容錯和負載均衡等功能,進一步簡化了大規模數據處理任務的運行過程。 除了HDFS和MapReduce之外,Hadoop還包含其他一些重要組件,如YARN(Yet Another Resource Negotiator)和Hadoop Common等。 YARN是一個資源管理器,負責調度作業、分配資源和監控任務的執行。 它通過智能地管理集群資源,確保Hadoop系統的高效運行。 Hadoop Common則包含一些通用的工具和庫,為Hadoop集群提供基本的功能,如配置管理、日志記錄和工具類庫等。 綜上所述,Hadoop的核心組件是分布式文件系統HDFS和分布式計算框架MapReduce。 它們共同構成了Hadoop生態系統的基礎,使得用戶可以在不了解分布式底層細節的情況下,開發分布式程序,充分利用集群的威力進行高速運算和存儲。 通過將這些組件結合起來,Hadoop為用戶提供了一個強大而靈活的平臺,用于處理和分析大規模數據。

Hadoop是一個開源的分布式處理框架,它能夠處理和存儲大規模數據集,是大數據處理的重要工具。 Hadoop主要由兩個核心組件構成:Hadoop Distributed File System (HDFS) 和 Hadoop MapReduce。 1. Hadoop Distributed File System (HDFS):HDFS是Hadoop的分布式文件系統,設計用來存儲和處理大規模的數據集。 它運行在集群的普通硬件上,具有很高的容錯性,通過數據復制和分布式處理來保證數據的高可用性。 HDFS將數據分割成塊并分布在集群的多個節點上,這樣可以在多個節點上并行處理數據,提高數據處理速度。 例如,一個大型企業每天可能產生TB級別的日志數據,這些數據可以存儲在HDFS上,并通過Hadoop進行高效處理。 2. Hadoop MapReduce:MapReduce是Hadoop的編程模型,用于大規模數據的并行處理。 它包含兩個階段:Map階段和Reduce階段。 在Map階段,輸入數據被分割成小塊并由Map任務并行處理;在Reduce階段,Map任務的輸出被匯總并由Reduce任務處理,生成最終結果。 MapReduce能夠自動處理并行化和故障恢復,使得開發者能夠更容易地編寫分布式應用。 例如,通過MapReduce可以編寫一個程序來計算網頁的訪問頻率。 Map任務處理每個網頁的訪問日志,輸出網頁和訪問次數;Reduce任務匯總每個網頁的訪問次數,得到最終結果。 除了這兩個核心組件外,Hadoop生態系統還包括很多其他組件和工具,如HBase(一個分布式的、可伸縮的大數據存儲庫)、Hive(用于數據查詢和分析的數據倉庫工具)、Pig(用于分析大數據的高級腳本語言)等,這些組件和工具使得Hadoop成為一個功能強大的大數據處理平臺。

Hadoop是一種專門設計用于大規模分布式計算和存儲的框架,其核心組件是HDFS(Hadoop Distributed File System)和MapReduce。 在Hadoop的工作流程中,HDFS扮演著關鍵角色。 它由一個主節點(Namenode,早期版本僅有一個,而在2.x版本中可有多個)和多個從節點(Datanode)組成。 Namenode主要負責接收用戶操作請求,這些請求可能來源于開發工程師編寫的Java代碼或命令行客戶端。 它負責維護文件系統的目錄結構,確保數據的邏輯關系和位置信息得到準確管理,并管理文件與數據塊(每個64M)之間的關聯。 在Hadoop的存儲策略中,文件被分割成多個數據塊,彼此之間具有順序關系。 Namenode負責跟蹤每個數據塊的分布情況,以及它們歸屬于哪個Datanode。 這種設計使得Hadoop能夠高效地存儲和管理海量數據,實現大規模數據的分布式處理。

內容聲明:

1、本站收錄的內容來源于大數據收集,版權歸原網站所有!

2、本站收錄的內容若侵害到您的利益,請聯系我們進行刪除處理!

3、本站不接受違法信息,如您發現違法內容,請聯系我們進行舉報處理!

4、本文地址:http://m.hudongshop.com/article/cb457ef8589979dfaecd.html,復制請保留版權鏈接!

歡迎來到電影剪輯的精彩世界!如果您渴望將您的視頻愿景變成現實,Movieclip就是您的終極解決方案,在全面的指南中,我們將逐步引導您了解Movieclip的強大功能,讓您掌控您的剪輯過程,創造出令人驚嘆的杰作,Movieclip的優勢用戶友好的界面,即使是初學者也可以輕松上手,強大的編輯工具,讓您剪切、修剪、合并和添加效果,廣泛的媒...。

技術教程 2024-09-24 08:04:49

引言VBscript,VisualBasicScriptingEdition,是一種微軟開發的腳本語言,廣泛應用于網頁制作、系統自動化和后端開發,由于其簡單易學、功能強大,VBscript深受廣大開發者的喜愛,本教程旨在全面解析VBscript的基礎語法,為初學者和有經驗的程序員提供一個全面的參考,數據類型VBscript支持多種數據...。

技術教程 2024-09-16 05:45:34

引言隨著技術的不斷進步,網頁設計趨勢也在不斷演變,為了確保您的網站在競爭中脫穎而出并提供最佳的用戶體驗,了解最新的趨勢至關重要,本文將深入探討當前網頁模版中普遍存在的設計和功能趨勢,幫助您的網站跟上時代步伐,現代設計原則簡約主義,注重干凈的線條、負空間和簡單的配色方案,響應式設計,確保網站在所有設備,臺式機、筆記本電腦、移動設備,上都...。

最新資訊 2024-09-16 00:50:30

表單是一種收集用戶輸入的數據結構,為了確保表單對所有用戶,包括殘疾用戶,都可訪問,重要的是使用語義化的HTML標簽,使用喇叭的最佳時間使用喇叭的最佳時間是什么時候,提交語義化HTML標簽以下是一些可用來創建可訪問表單的語義化HTML標簽,<,label>,將標簽與表單控件關聯,為屏幕閱讀器提供信息,<,input>,...。

本站公告 2024-09-15 22:30:52

并發編程的三要素并發編程是編寫可同時執行多個任務的程序的過程,為了實現并發性,程序必須滿足以下三個要素,并發性,程序能夠同時執行多個任務,而這些任務可以獨立運行或并行運行,共享狀態,并發任務可以訪問和修改同一共享狀態,例如內存中的變量或數據結構,同步,并發任務必須以協調一致的方式訪問共享狀態,以避免數據競爭,racecondition...。

本站公告 2024-09-15 20:40:38

使用嵌套過多,因為這會降低性能,使用命名范圍來增強可讀性和可維護性,使用錯誤處理函數來處理錯誤值,通過使用快捷鍵和功能區自定義來提高工作效率,結論學習Excel公式是一個持續的過程,需要練習和探索,通過掌握本指南中的基礎知識和高級技術,你可以解鎖Excel的真正力量并提高你的數據分析和工作表管理技能,...。

互聯網資訊 2024-09-13 14:06:14

勵,使用商店,你可以使用游戲中的貨幣,鉆石,在商店購買使者進階圖紙,使用year函數,你可以檢查游戲中使者進階圖紙的可用性,例如,以下代碼將返回當前年份中所有可用使者進階圖紙的列表,SELECTFROMtable,nameWHEREyear,date,available,=year,CURRENT,DATE,總結year函數是一個多...。

本站公告 2024-09-13 12:02:48

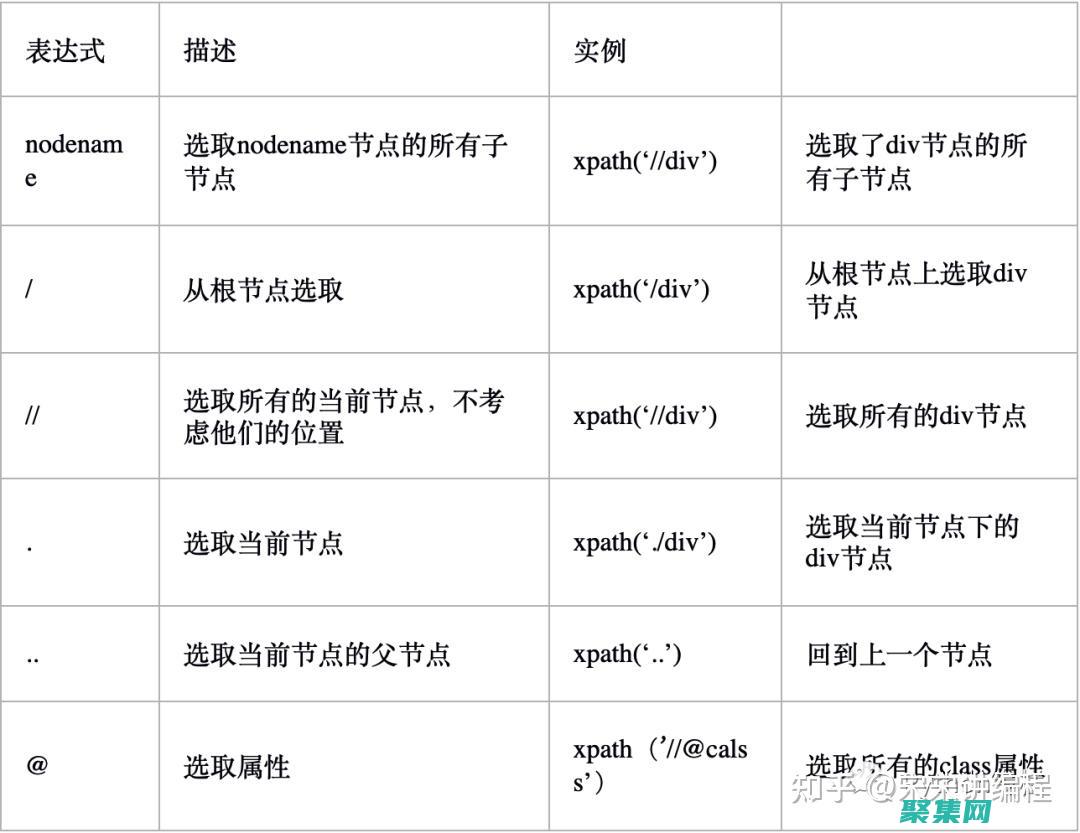

爬蟲程序,又稱網絡爬蟲,是一種自動化程序,用于從互聯網上收集數據,它們可以執行從簡單頁面抓取到復雜數據分析的各種任務,盡管爬蟲程序非常有用,但重要的是要意識到使用它們的道德和責任,爬蟲程序的道具有哪些,爬蟲程序可以擁有各種功能,包括,從網站上抓取HTML、CSS和JavaScript文件分析頁面內容,提取文本、圖像和鏈接遵守網站的ro...。

互聯網資訊 2024-09-12 23:13:05

簡介在處理數據時,四舍五入是一個重要的操作,可以提高數據精度和可用性,在Excel中,Roundup函數是一個功能強大的工具,可以輕松地四舍五入數字,本文將深入探討Roundup函數,包括其語法、用法、示例和高級技巧,語法=ROUNDUP,number,num,digits,number,要四舍五入的數字,num,digits,以小數...。

最新資訊 2024-09-12 17:56:24

超越想象的H5游戲開發,H5游戲平臺源碼的終極秘訣引言在當今快節奏的數字世界中,H5游戲已成為吸引受眾和提供沉浸式娛樂體驗的強大工具,隨著H5游戲平臺源碼的不斷發展,開發者現在有能力創造以前無法想象的游戲體驗,本文將深入探討H5游戲平臺源碼的奧秘,揭示其創建令人驚嘆的H5游戲的終極秘訣,H5游戲平臺源碼的概念H5游戲平臺源碼是一種軟件...。

技術教程 2024-09-11 09:49:46

在本文中,我們將介紹如何使用JavaXFire框架創建、部署和消費Web服務,XFire是Apache捐贈給Apache軟件基金會的開源Web服務框架,XFire提供了一個易于使用的API來創建和部署Web服務,并通過支持多種傳輸協議,包括HTTP、SOAP和REST,和數據綁定框架,包括JAXB和XStream,來支持廣泛的Web服...。

最新資訊 2024-09-10 23:55:55

數據庫是企業和組織的關鍵資產,其包含著重要的業務數據,為了維護數據安全性和確保業務連續性,定期備份和恢復數據庫至關重要,備份的重要性備份是創建和存儲數據庫副本的過程,以下是備份的幾個重要性,數據保護,備份提供了一種在數據丟失或損壞,例如由于硬件故障、軟件故障或人為錯誤,時恢復數據的機制,業務連續性,在發生災難或停機時,備份允許企業快速...。

本站公告 2024-09-10 19:45:11